Part02 ☀️

Part02 ☀️

课程内容

- 大模型部署

- 大模型介绍 🍐

- Ollama安装和使用 ✏️

- Chatbox ✏️

- RAG知识讲解🍐

- 创建本地知识库 ✏️

- 知识库

- Obsidian介绍和安装 ✏️

- Obsidian常规使用 ✏️

- Obsidian集成大模型和RAG功能 ✏️

- Obsidian实战操作 ✏️

1 大模型部署

1.1 大模型介绍

前言

1. 什么是大模型?

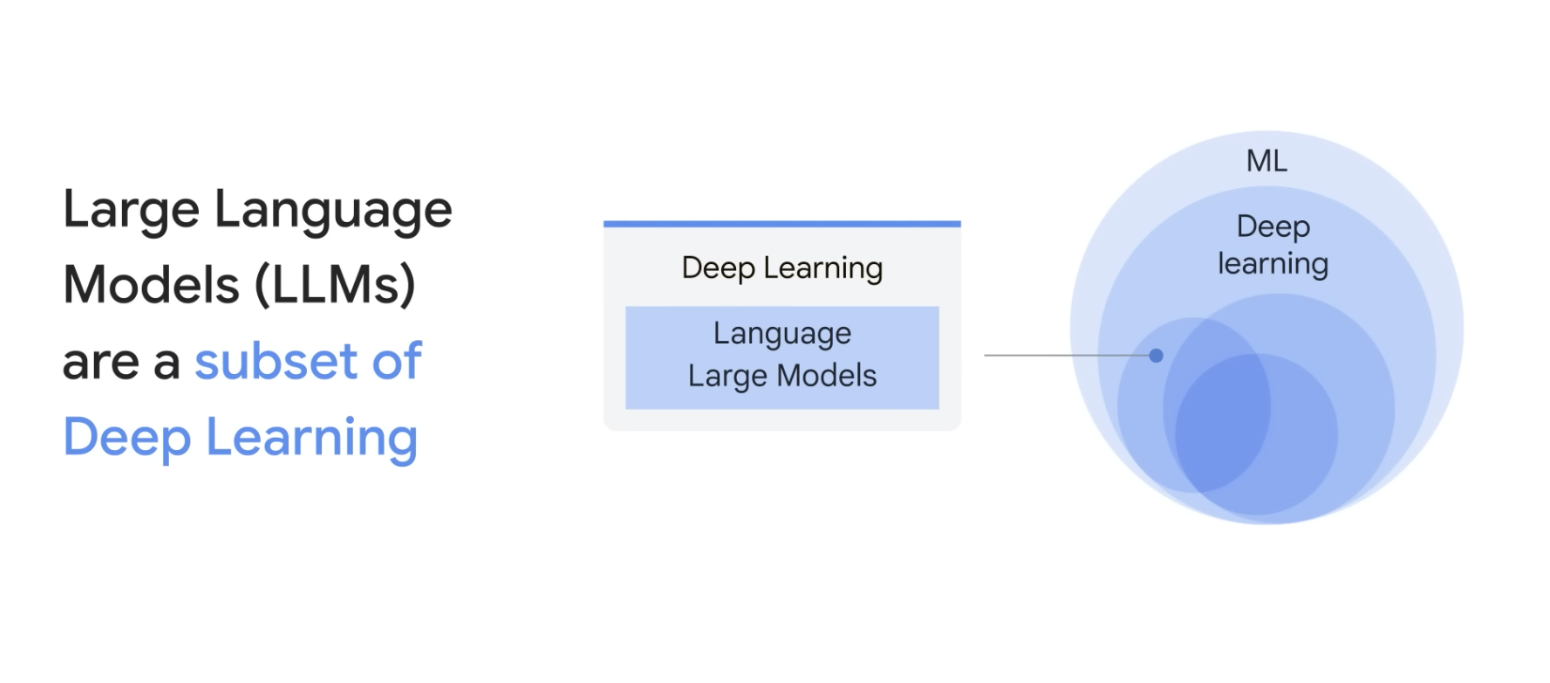

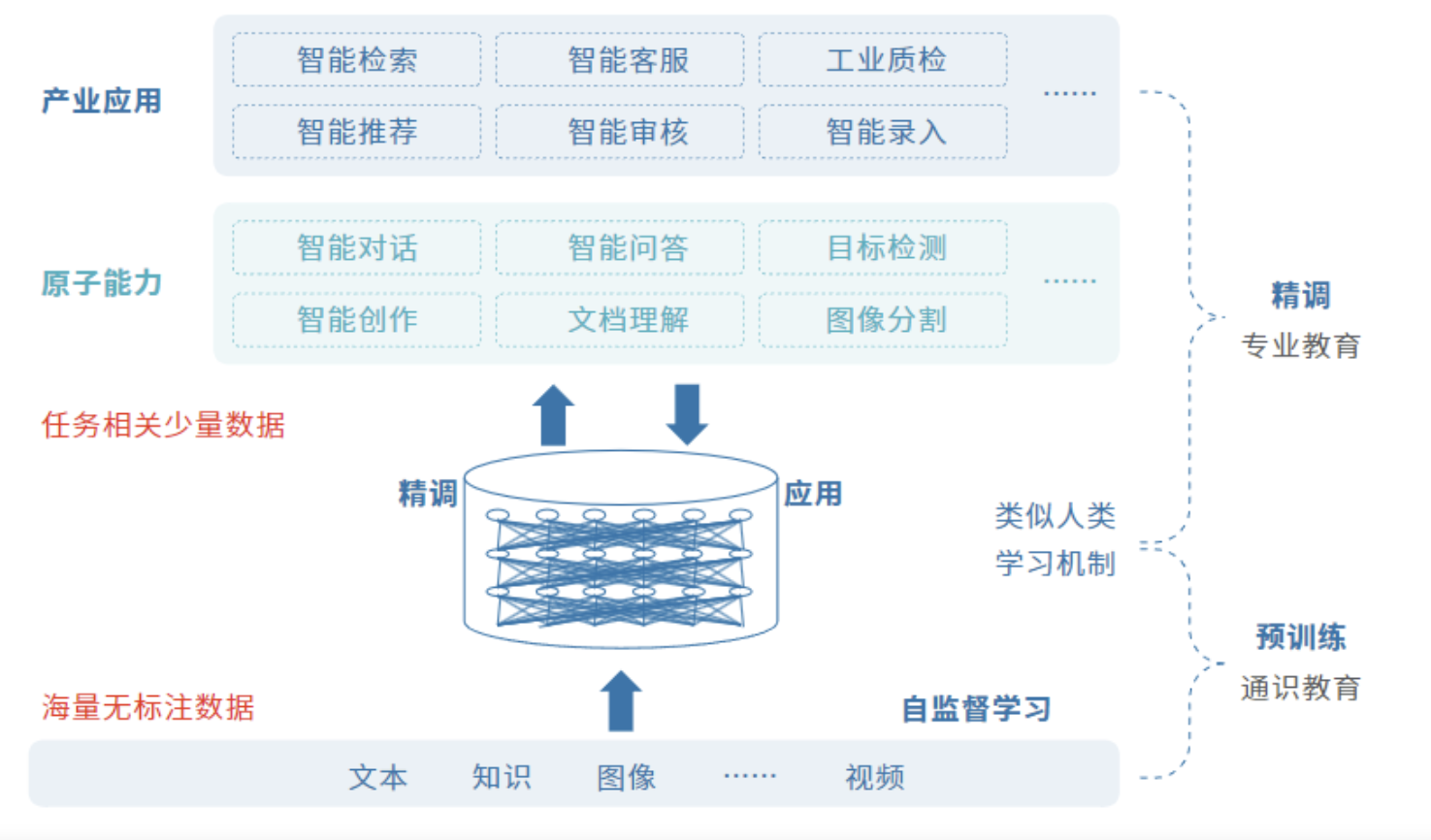

大语言模型(LLM, Large Language Model) 是一种基于Transformer架构的深度学习模型,通过预训练大量文本数据,能够理解和生成人类语言。

核心特点

- 参数量巨大:从1.5B到671B不等

- 自监督学习:无需人工标注数据

- 多任务能力:文本生成、问答、翻译、编程等

- 上下文理解:能够理解长文本的语义

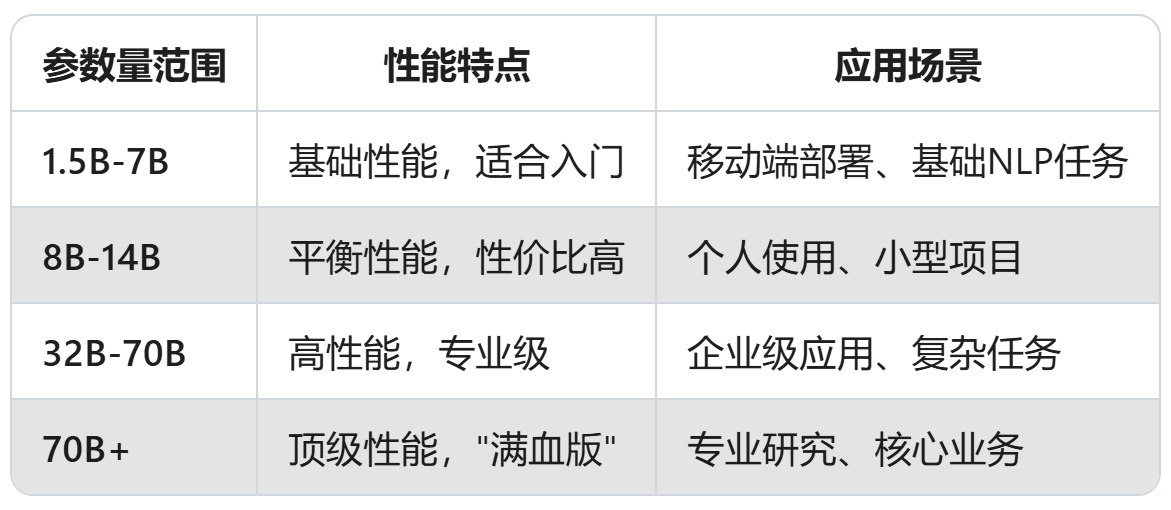

2. 参数量解析:1.5B、7B、14B...到底是什么意思?

B = Billion(十亿),这是国际通用的参数量表示方式。

参数量与性能的关系

3. 主流开源大模型大盘点

🏆 Top 5 开源大模型

- Meta LLaMA 3

- 版本:8B、70B

- 特点:通过RLHF微调,性能媲美闭源模型

- 优势:开源透明,可自由定制优化

- 应用:聊天机器人、编程任务、多语言处理

2. DeepSeek-R1 : ❤️

- 版本:1.5B、7B、8B、14B、32B、70B、671B

- 特点:参数量跨度极大,从轻量级到顶级性能

- 优势:灵活选择,适应不同硬件配置

- 应用场景:从个人学习到企业级部署

3. GPT-NeoX

- 版本:GPT-NeoX-20B

- 特点:200亿参数,开源替代GPT

- 优势:高性能,代码生成能力强

4. Qwen系列 ❤️

- 版本:0.5B到72B全尺寸覆盖

- 特点:中文支持优秀,多模态能力强

- 优势:本地化适配,企业级应用成熟

4. 硬件配置要求详解

🖥️ 内存(RAM)要求

根据Ollama官方推荐:

| 模型大小 | 最低RAM要求 | 推荐RAM | 说明 |

|---|---|---|---|

| 1.5B | 4GB | 8GB | 轻量级,适合入门 |

| 7B | 8GB | 16GB | 标准配置,性价比高 |

| 13B-14B | 16GB | 32GB | 平衡性能,主流选择 |

| 32B-70B | 32GB | 64GB+ | 高性能,需要强大硬件 |

📱 其他硬件要求

- CPU:现代多核处理器(4核+)

- GPU:显存≥模型大小(如7B模型需要≥8GB显存)

- 在NPU(神经网络处理单元)上部署大模型可以显著提升推理效率,适用于自然语言处理等场景

- 存储:SSD,空间≥模型文件大小(通常几十GB)

5. 大模型核心特点与优势

🎯 核心能力综合表

| 能力维度 | 具体功能 | 特点说明 |

|---|---|---|

| 📊 多模态处理能力 | 文本生成、问答、翻译 | 基础语言理解与生成能力 |

| 代码生成与调试 | 编程辅助与错误修复能力 | |

| 图像描述生成 | 视觉内容理解与描述 | |

| 🔄 自学习能力 | 无需人工标注数据 | 自监督学习机制 |

| 持续优化学习效果 | 随使用时间提升性能 | |

| 适应不同领域知识 | 跨领域泛化能力 | |

| 🧠 上下文理解 | 长文本处理能力 | 理解复杂、长篇内容 |

| 逻辑推理能力 | 推理、分析与判断 | |

| 跨领域知识整合 | 综合多领域信息 |

📊 性能指标对比

| 模型 | 参数量 | 推理速度 | 准确性 | 资源消耗 |

|---|---|---|---|---|

| Llama3-8B | 8B | 快速 | 高 | 中等 |

| DeepSeek-7B | 7B | 快速 | 高 | 中等 |

| Llama3-70B | 70B | 较慢 | 极高 | 高 |

| DeepSeek-671B | 671B | 很慢 | 顶级 | 极高 |

总结

课堂作业

- 参数量含义:B = Billion(十亿),直接影响模型性能和硬件需求

- 主流模型:LLaMA 3、DeepSeek-R1、Mistral、GPT-NeoX、Qwen等

- 配置要求:内存需求与模型大小直接相关,7B模型需要8GB+内存

- 应用价值:从个人学习到企业级应用,适用场景广泛

1.2 AI智能助手概览

前言

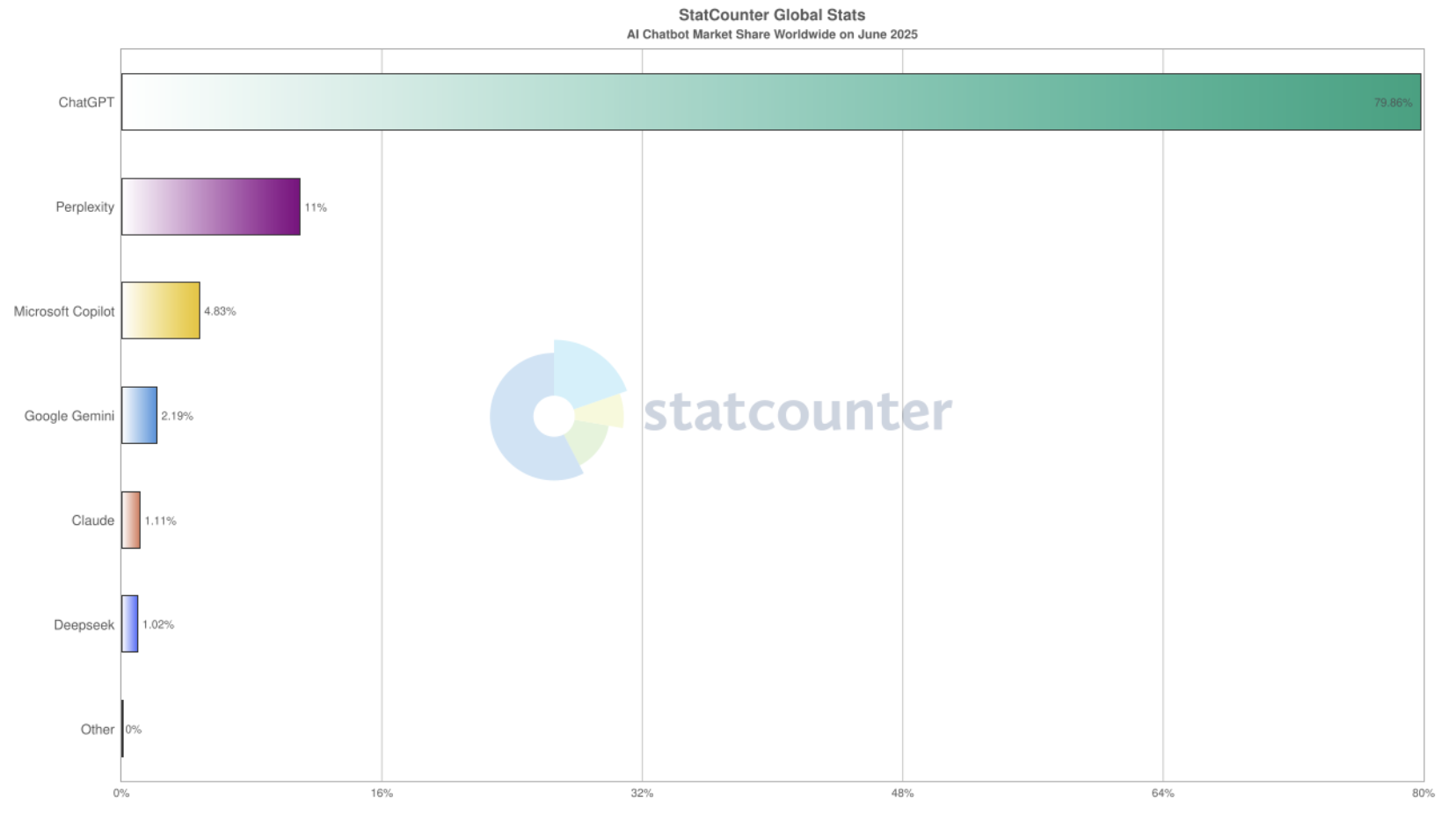

1. 全球AI助手发展现状(2024-2025)

最新市场数据显示:2025年6月全球AI聊天机器人产品中,ChatGPT市场占比接近80%,稳居全球第一

这反映了OpenAI在AI助手领域的绝对领先地位。

🎯 国外主要玩家

| 平台 | 开发商 | 核心优势 | 最新进展 |

|---|---|---|---|

| ChatGPT | OpenAI | 全能型、生态丰富 | 市场份额接近80%,推出Operator智能体 |

| Claude | Anthropic | 编程强、推理优 | 持续优化推理能力,企业级应用拓展 |

| Gemini | Google DeepMind | 多模态强、集成度高 | 推出Gemini 2.0,Project Astra项目 |

| Grok | xAI (马斯克) | 实时信息、个性鲜明 | 推出Grok-3,与中国AI公司竞争 |

国外的收费模式主要是企业订阅和个人付费,根据订阅的次数或者时间长度、或者使用次数来定价。国内访问受限,需要通过第三方平台或者使用科学工具才能访问。

🎯国内AI助手阵营

第一梯队:

创新势力:

2.📈 技术演进路径

- 从ChatBot到智能体(Agent)的发展

传统ChatBot → 智能Agent

被动响应 → 主动规划

单任务处理 → 多任务协作

文本交互 → 多模态感知

工具调用 → 环境交互ChatBot其实就是聊天机器人,本质是提供交互式的人机对话体验

作为ChatBot的升级版,智能体赋予了Agent自主执行任务的能力,能够自我感知、多模态感知、推理、决策等

- 多模态能力的融合演进

技术发展脉络:

- 单模态 → 多模态融合

- 文本为主 → 图文并茂 → 音视频交互

- 独立处理 → 跨模态理解

单模态学习 指的就是对同一类别的数据进行处理、训练和推理的过程

多模态学习 是指同时使用或分析多种模态的数据(如文本、图像、音频等)共同处理、训练和推理,以提供更加丰富和全面的信息。

跨模态学习 可以认为是多模态学习的一个分支,只不过两者关注的重点不同。多模态学习关注的是两种不同

模态语义对齐,而跨模态关注的是将不同模态之间的数据进行相互转换和映射例如:在华为平板上问“小艺小艺,屏幕中的是什么花?“

- 这个过程,首先将语音模态的数据映射到文本模态,进行语音转文字的识别,随后又将图像模态的数据映射到文本模态上,实现图像问答。如下图

代表产品:

总结

1.3 Ollama安装和使用

Ollama安装和使用

1、基本介绍

Ollama是一个支持在Windows、Linux和MacOS上本地运行大语言模型的工具。它允许用户非常方便地运行和使用各种大语言模型,比如Qwen模型等。用户只需一行命令就可以启动模型 。

主要特点包括:

- 跨平台支持Windows、Linux、MacOS系统。

- 提供了丰富的模型库,包括Qwen、Llama等1700+大语言模型,可以在官网model library中直接下载使用。

- 支持用户上传自己的模型。用户可以将huggingface等地方的ggml格式模型导入到ollama中使用。也可以将基于pytorch等格式的模型转换为ggml格式后导入。

- 允许用户通过编写modelfile配置文件来自定义模型的推理参数,如temperature、top_p等,从而调节模型生成效果。

- 支持多GPU并行推理加速。在多卡环境下,可以设置环境变量来指定特定GPU。

总的来说,Ollama降低了普通开发者使用大语言模型的门槛,使得本地部署体验大模型变得简单易行。对于想要搭建自己的AI应用,或者针对特定任务调优模型的开发者来说,是一个非常有用的工具。它的一些特性,如允许用户自定义模型参数,对模型进行个性化适配提供了支持。

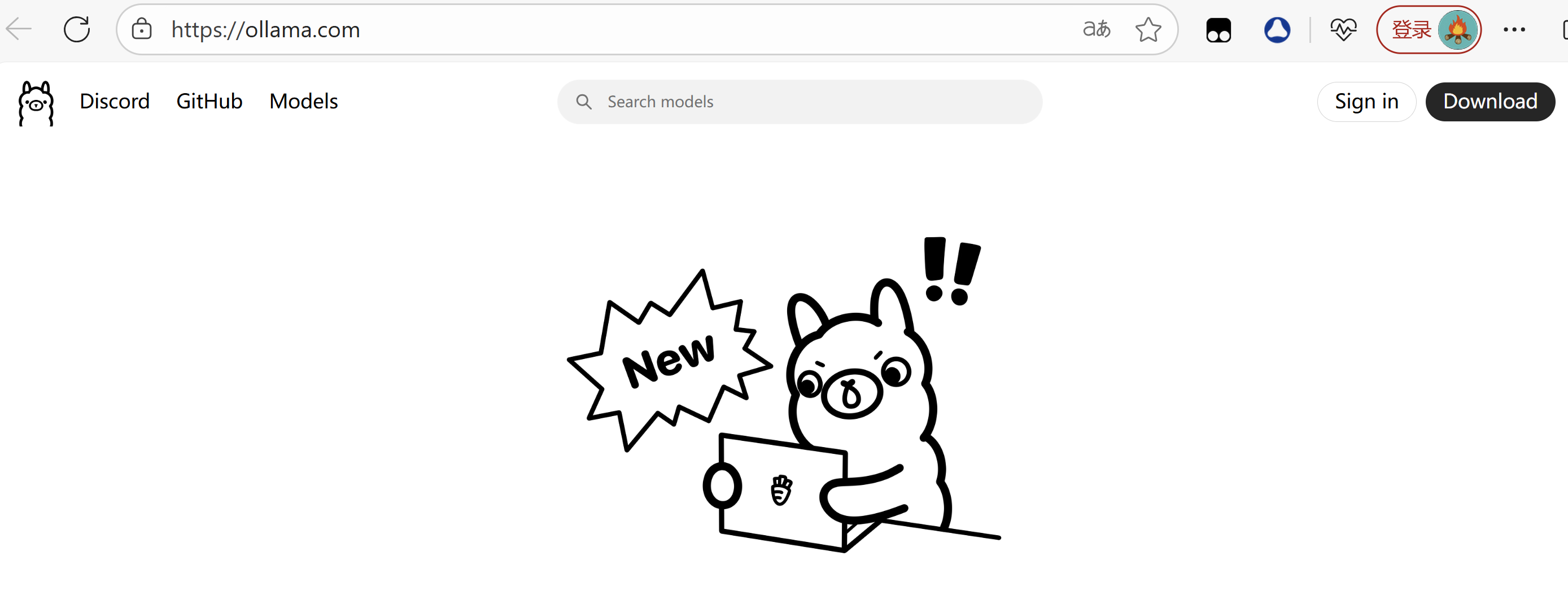

2、官网和下载链接

Ollama 下载:https://ollama.com/download

Ollama 官方主页:https://ollama.com

Ollama 官方 GitHub 源代码仓库:https://github.com/ollama/ollama/

说明:在国内下载速度很慢!!,容易出现下载失败的情况,建议使用VPN下载。

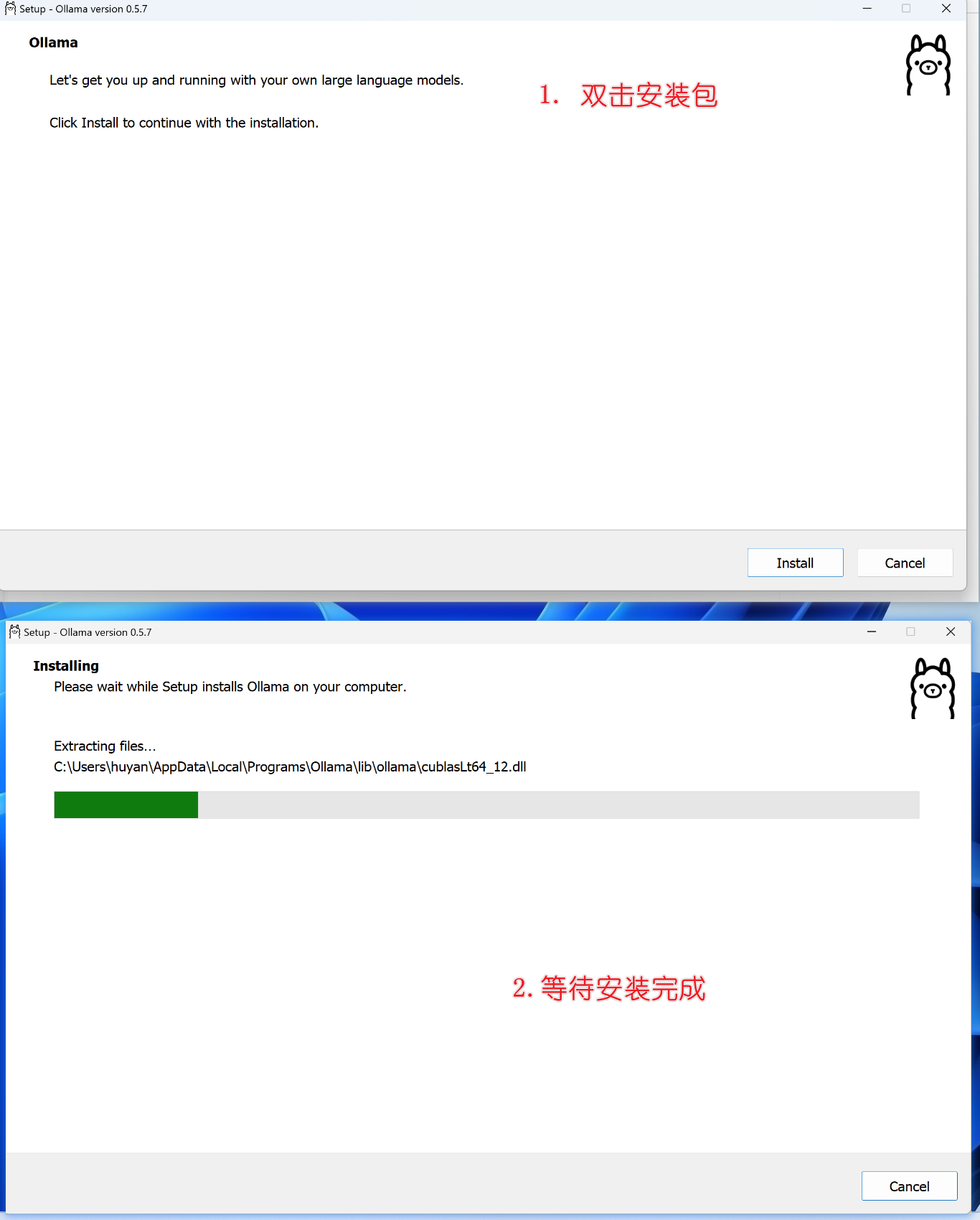

3、安装教程

1. 选择安装文件,右击管理员运行安装

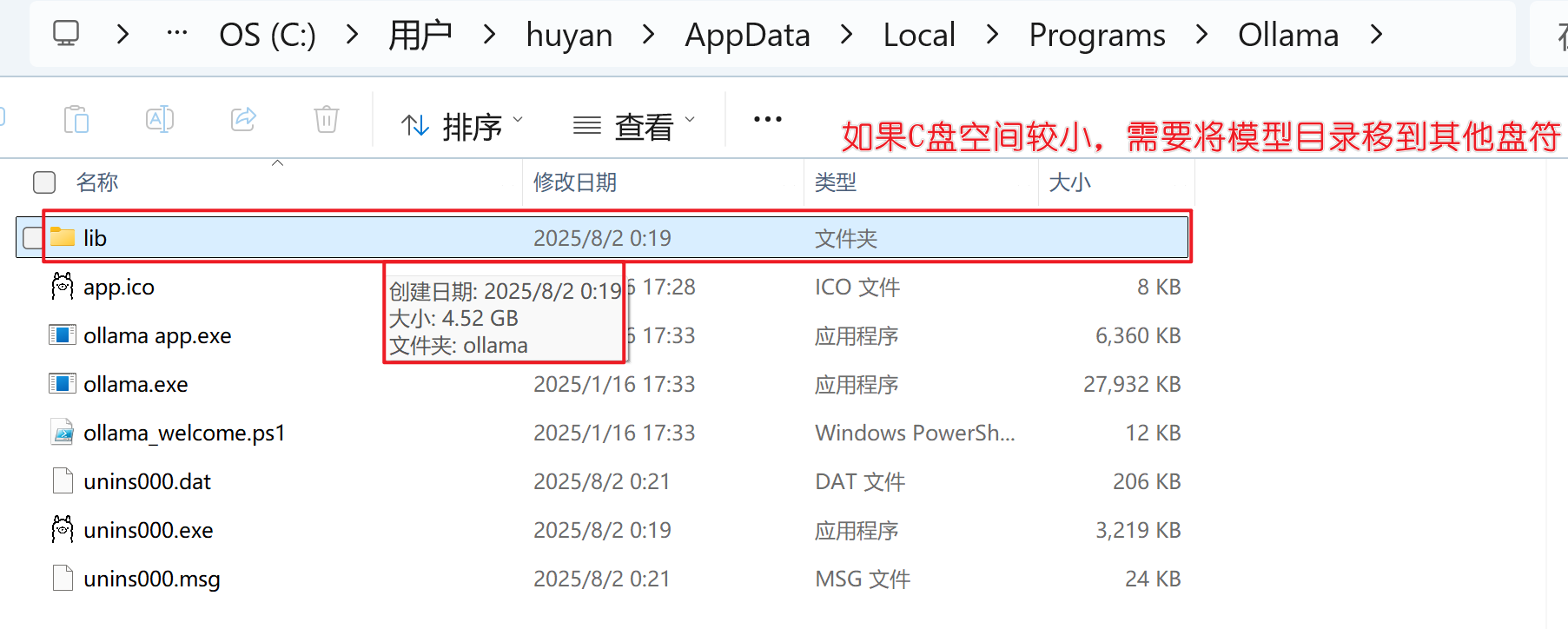

2. 在window中,默认的位置在C盘(如下👇),后期的模型下载也会在C盘,但是模型文件比较大,占用存储空间,推荐安装在其他盘。

C:\Users\用户名\AppData\Local\Programs\Ollama

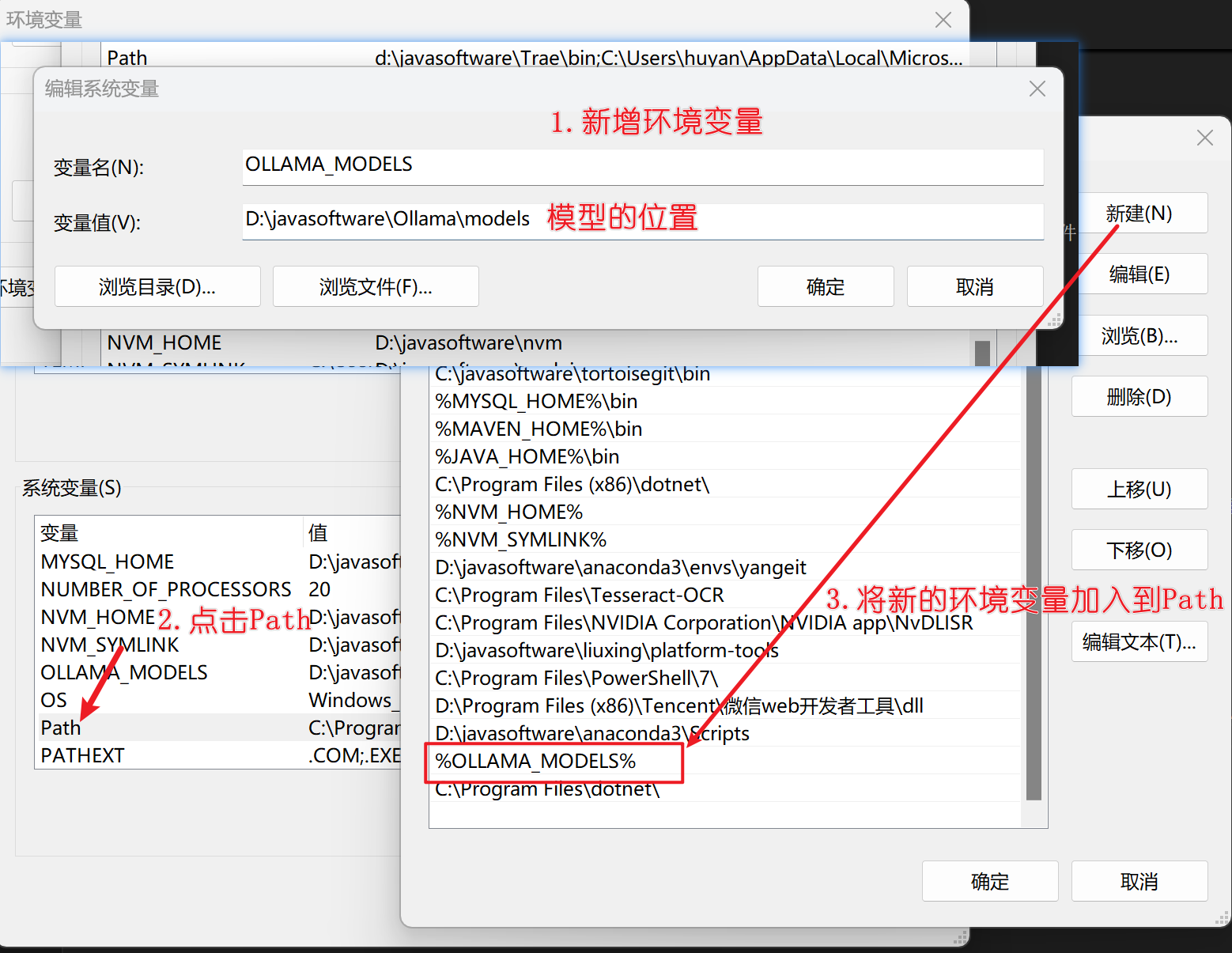

3. 配置环境变量。将模型目录配置到其他的路径如:D:\javasoftware\Ollama\models

右键我的电脑-->属性-->高级系统设置-->环境变量-->系统环境变量 -->新增-->输入OLLAMA_MODELS :D:\javasoftware\Ollama\models

上图是配置环境变量,然后停止Ollama服务(观察右下角的任务栏是否有Ollama图标, 如果是英特尔优化版,直接关闭cmd窗口即可,如下图👇)

4. Ollama指令

# 1、打开cmd窗口,启动Ollama 服务(cmd窗口不要关闭,启动后关闭则服务不启动):

ollama serve

# 可以使用ollama -v查看版本。使用-h 查看帮助命令

#2、拉取模型

ollama pull <模型名字>

#如拉取deepseek-r1:1.5b模型:

ollama pull deepseek-r1:1.5b

#3、下载完成后,运行:ollama list 查看下载的模型列表,

ollama list

#返回下载的结果:模型名字---模型id---模型占用的大小---修改时间

NAME ID SIZE MODIFIED

bge-m3:latest 790764642607 1.2 GB 16 hours ago

deepseek-r1:7b 755ced02ce7b 4.7 GB 17 hours ago

qwen3:8b 500a1f067a9f 5.2 GB 18 hours ago

#4、启动Ollama

ollama run deepseek-r1:1.5b

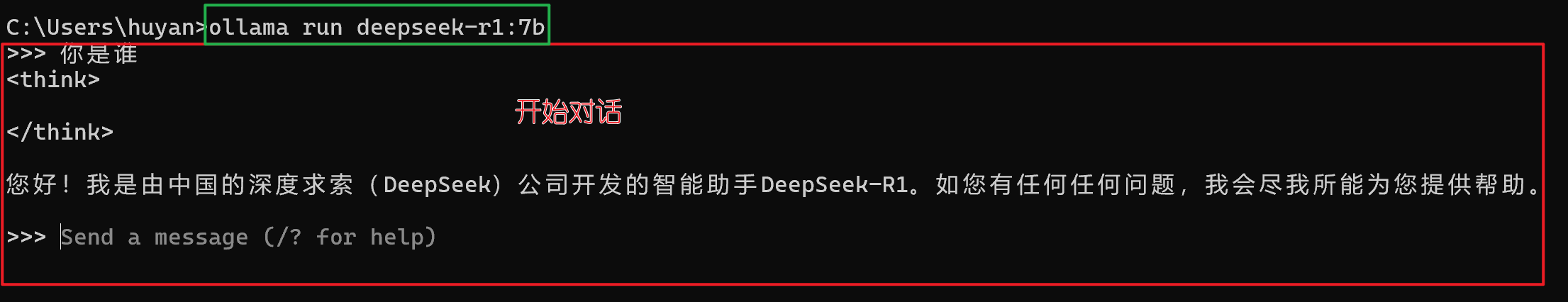

#5、启动后,可以在黑窗口中输入想问的话,如:"你是谁",然后按回车键,即可得到回复。,如图7所示。

#6、如果想退出,按Ctrl+D即可,即可停止退出对话

#7、 查看正在运行的模型

ollama ps

#返回结果: 模型名字---模型id---模型占用的大小---cpu或gpu占比---运行了多久

NAME ID SIZE PROCESSOR UNTIL

deepseek-r1:7b 755ced02ce7b 6.0 GB 43%/57% CPU/GPU 2 minutes from now

#8、停止模型:

ollama stop <模型名字> #如停止deepseek-r1:7b模型:

ollama stop deepseek-r1:7b

# 可以再次执行ollama ps 查看是否停止

#9、删除模型:

ollama rm <模型名字> #如删除deepseek-r1:7b模型:

ollama rm deepseek-r1:7b

# 可以再次执行ollama list 查看是否删除

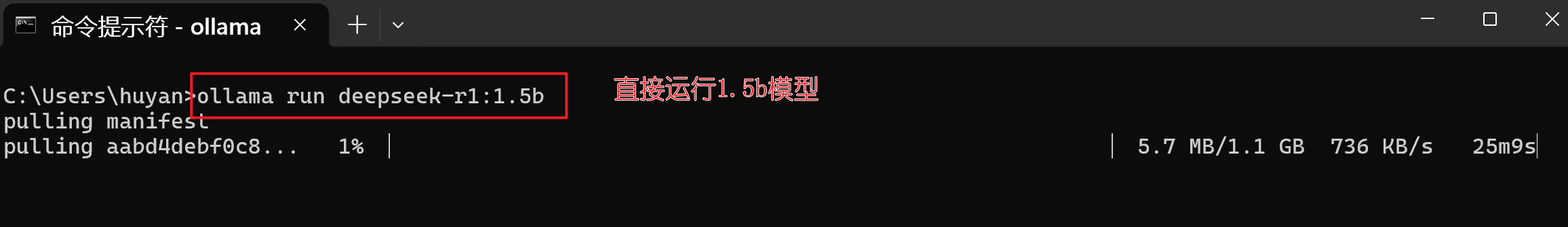

# 补充:可以在一开始就直接运行ollama run xxx ,可以直接运行某个模型并运行,如图8所示

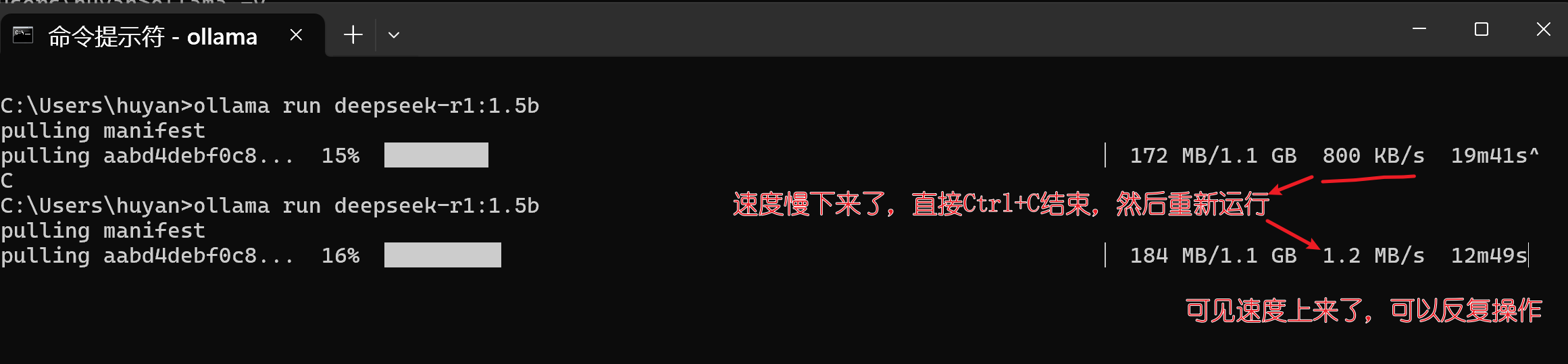

注意,如果下载到后期速度很慢,可以Ctrl+C停止下载,然后重新运行下载指令即可,速度会快很多。如图9所示。

总结

课堂作业

安装ollama,并配置环境变量,和deepseek-r1:1.5b模型(比较小,大概1.1g),然后在黑窗口中输入问题并得到回答!microphone:

如果有时间,花点时间下载deepseek-r1:7b模型,和嵌入模型bge-m3:latest

ollama pull deepseek-r1:7b

ollama pull bge-m3

# 调用ollama list 查看下载情况